Macht KI doof? Warum die neue KI-Bequemlichkeit ein großes Risiko ist.

Ein Bild spricht Bände: Haben Sie schon mal versucht, pure Intelligenz mit einem Hammer zu bändigen?

Hier sehen wir die Tragödie unserer Wirtschaft in einem Bild: Ein 1,0-Diplom in Künstlicher Intelligenz in der einen Hand, aber nicht genug motorisches Geschick in der anderen, um einen simplen Nagel unfallfrei in die Wand zu befördern.

Wir züchten eine Elite heran, die neuronale Netze im Schlaf optimiert, aber kläglich scheitert, sobald die Lösung nicht aus Code, sondern aus Stahl und Holz besteht. Was nützt dir der beste Algorithmus der Welt, wenn dich die Schwerkraft und ein 500-Gramm-Hammer in deine Schranken weisen?

Und ja, ich sage das als jemand, der seit Jahren KI in der Lehre und in Unternehmen einsetzt — nicht als Kulturpessimist, sondern als jemand, der die Forschungslage kennt.

Das Problem ist real — und es hat einen Namen

Die Psychologie nennt es Cognitive Offloading: die Auslagerung geistiger Anstrengung an externe Werkzeuge. Was beim Notizbuch beginnt, endet bei ChatGPT, Claude und Copilot. Die Frage ist nicht, ob wir auslagern — sondern wie viel wir auslagern, bevor wir unsere eigenen Fähigkeiten verlieren.

Die Studienlage 2025/2026 ist dabei erschreckend eindeutig:

Die Shen-&-Tamkin-Studie (Januar 2026) untersuchte in einem randomisierten Experiment, wie sich KI-Nutzung auf den Kompetenzerwerb von Softwareentwicklern auswirkt. Das Ergebnis: Wer Aufgaben vollständig an die KI delegierte, wurde zwar kurzfristig schneller — verlor aber das konzeptionelle Verständnis, die Fähigkeit zum Code-Lesen und zum Debugging. Die Effizienzgewinne? Im Durchschnitt nicht einmal signifikant. Die Kompetenz-Verluste dagegen: messbar und deutlich.

Sechs verschiedene Interaktionsmuster mit KI wurden identifiziert — und nur drei davon bewahrten die Lernfähigkeit. Was diese drei gemeinsam hatten? Kognitive Eigenleistung. Die Teilnehmer nutzten KI als Sparringspartner, nicht als Ersatz für das eigene Denken.

Die Microsoft-Research-Studie (Lee et al., 2025) mit 319 Wissensarbeitern zeigte einen beunruhigenden Zusammenhang: Je höher das Vertrauen in die KI, desto geringer die Fähigkeit zum kritischen Denken. Der Fachbegriff dafür: Automation Bias — die Tendenz, maschinellen Outputs blind zu vertrauen, weil sie schnell, eloquent und autoritär klingen.

Und eine aktuelle Frontiers-Studie (März 2026) bestätigt: Wer an Aufgaben dranbleibt, tut dies vor allem dann, wenn die eigene Selbstwirksamkeitsüberzeugung stark ist — nicht wenn Tools bereitstehen. Kritisches Denken hingegen wird sowohl durch innere Überzeugung als auch durch die Art des Werkzeugeinsatzes beeinflusst.

Die Kernfrage: Wer profitiert wirklich von der Bequemlichkeit?

Die WiWo-These im Artikel „Ein Lob der Anstrengung“ vom 25.3.26 führt an, dass die Vermeidung von Anstrengung ein fataler Fehler ist. Doch die These greift zu kurz, wenn sie bei einem moralischen Appell stehen bleibt – so wie in der Wirtschaftswoche. Denn das Problem ist kein individuelles Versagen — es ist ein systemisches Versäumnis.

Wenn Unternehmen KI einführen, um Kosten zu sparen, und gleichzeitig erwarten, dass Mitarbeitende weiterhin kompetent und urteilsfähig bleiben, dann ist das ein Widerspruch. Wenn Schulen bis Hochschulen Studierende für eine KI-durchdrungene Arbeitswelt ausbilden, aber keine Strukturen schaffen, die eigenständiges Denken belohnen, dann züchten sie eine Generation eleganter Prompter — ohne Substanz.

Die Forschung zur „Hollowed Mind“-Hypothese bringt es auf den Punkt: Es gibt einen fundamentalen Unterschied zwischen Performance (Leistung im Moment, mit dem Tool) und Competence (nachhaltige Fähigkeit, auch ohne das Tool). Wer nur Performance misst, übersieht den schleichenden Kompetenzverlust.

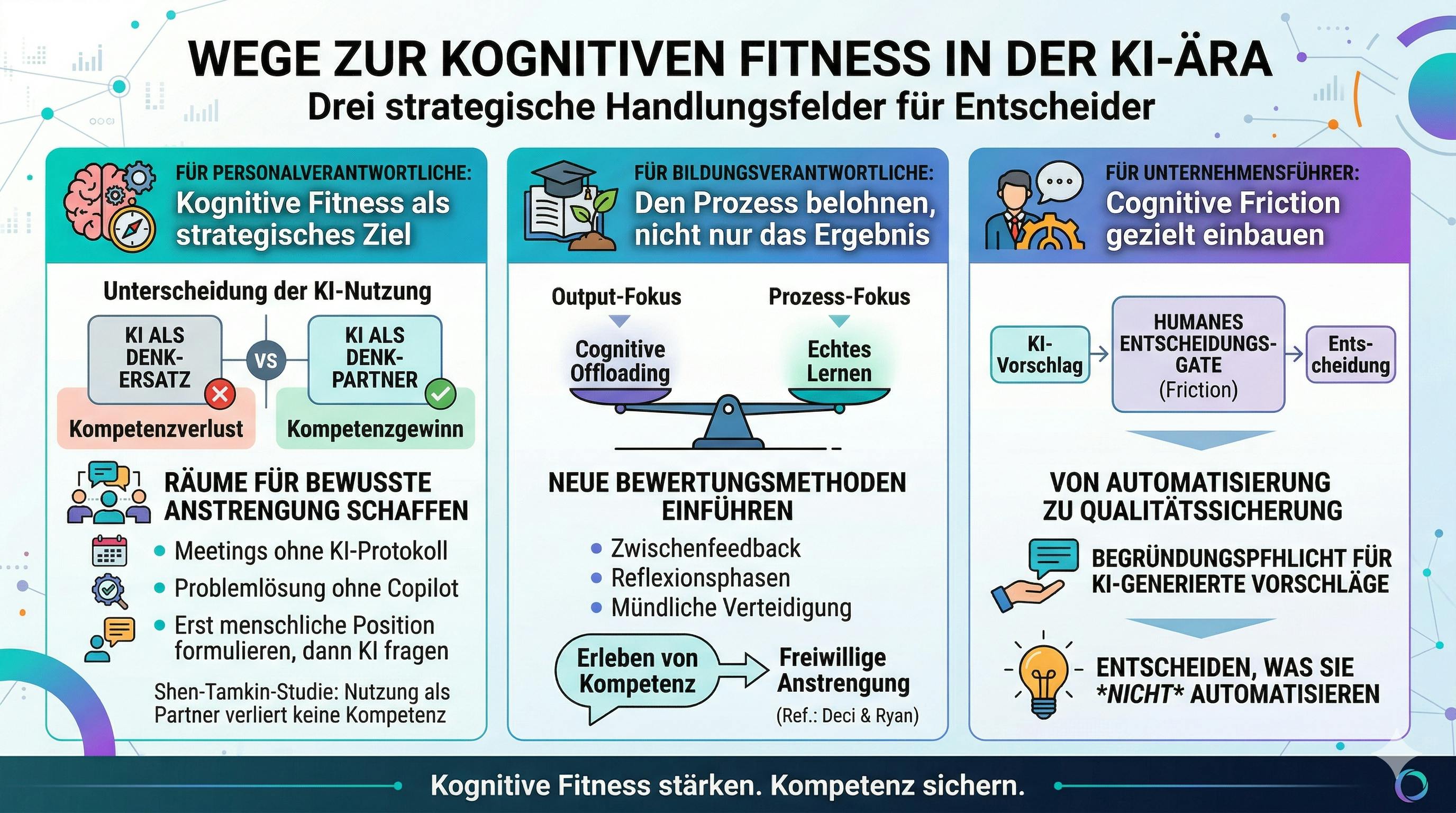

Was das für Sie als Entscheider bedeutet — drei Handlungsfelder

1. Für Personalverantwortliche: Kognitive Fitness als strategisches Ziel definieren

Hören Sie auf, KI-Nutzung pauschal als Produktivitätshebel zu feiern. Führen Sie stattdessen eine Unterscheidung ein: Wo beschleunigt KI Routinearbeit? (Gut.) Wo ersetzt KI das Denken, das Ihre Mitarbeitenden eigentlich erst kompetent macht? (Gefährlich.)

Konkret heißt das: Schaffen Sie Räume für bewusste Anstrengung — Meetings ohne KI-Protokoll, Problemlösungssessions ohne Copilot, strategische Diskussionen, in denen Menschen zuerst ihre eigene Position formulieren, bevor sie die KI fragen. Die Shen-Tamkin-Studie zeigt: Wer KI als Denkpartner statt als Denkersatz nutzt, verliert keine Kompetenz.

2. Für Bildungsverantwortliche: Den Prozess belohnen, nicht nur das Ergebnis

Die Hochschuldidaktik-Forschung ist hier eindeutig: Wenn ausschließlich das Endprodukt bewertet wird, ist Cognitive Offloading die rationale Strategie. Warum sollte jemand selbst denken, wenn die Note vom Output abhängt — und der Output mit KI besser wird?

Die Lösung: Zwischenfeedback, Reflexionsphasen, mündliche Verteidigung. Studierende und Mitarbeitende müssen erleben, dass der Weg zum Ergebnis Wert hat — dass ihre Anstrengung gesehen wird. Die Motivationsforschung (Deci & Ryan) bestätigt: Wer sich als kompetent erlebt, strengt sich freiwillig mehr an. Wer nur unter Notendruck oder KPI-Druck steht, optimiert den Output — auf Kosten des Lernens.

3. Für Unternehmensführer: Cognitive Friction gezielt einbauen

Klingt paradox? Ist es nicht. Kognitive Reibung — also bewusste Verlangsamung im Denkprozess — ist das Gegenmittel zum KI-induzierten Kompetenzverlust. In der Praxis bedeutet das: Bevor ein KI-generierter Vorschlag übernommen wird, muss die verantwortliche Person begründen, warum sie ihn für richtig hält. Nicht als Bürokratie, sondern als Qualitätssicherung des Denkens.

Die besten Unternehmen werden in Zukunft nicht die sein, die am meisten automatisieren — sondern die, die am klügsten entscheiden, was sie NICHT automatisieren.

Das Lob der Anstrengung — aber richtig verstanden

Die WiWo hat schon Recht, wenn sie fordert, dass Anstrengung wieder Wertschätzung verdient. Aber Anstrengung ist kein Selbstzweck und kein moralisches Verdienst. Anstrengung ist der Preis für Kompetenz. Wer ihn nicht zahlt, wird abhängig — von Tools, von Algorithmen, von denjenigen, die noch selbst denken können.

Das gilt für Ihre Mitarbeitenden. Das gilt für Ihre Studierenden. Und, seien wir ehrlich: Das gilt auch für uns selbst.

Die Frage ist nicht, ob wir KI nutzen. Die Frage ist, ob wir dabei den Muskel des eigenen Denkens trainieren — oder verkümmern lassen.

Wer heute das Denken delegiert, wird morgen nicht mehr entscheiden können, ob die Antwort stimmt. 🎓

Quellen & Leseempfehlungen zu „Macht KI doof?“:

- WirtschaftsWoche: „Ein Lob der Anstrengung“ (23.03.2026) — wiwo.de

- Shen, J. H. & Tamkin, A. (2026): How AI Impacts Skill Formation. arXiv:2601.20245

- Lee et al. (2025): Microsoft Research Study on GenAI Confidence and Critical Thinking, 319 Wissensarbeiter, 936 Tasks

- Frontiers in Psychology (März 2026): Cognitive Offloading through Digital Tools and its Relationship with Critical Thinking, Task Persistence, and Learning Depth

- Clark & Chalmers (1998) vs. „Extended Hollowed Mind“-Hypothese (2025): Performance ≠ Competence

Fragen, Widerspruch, eigene Erfahrungen? Antworten Sie direkt in die Kommentare